오픈AI의 ChatGPT가 시작한 생성형 AI 서비스가 아무리 활성화 된다하더라도

내 생활은 큰 변화가 없을 것으로 생각했습니다.

그래봐야 얼마전까지 우리나라에서 유행했던 인공지능 스피커의 수준이라 생각했거든요.

그런데, ChatGPT의 수준이 점점 올라가고 구글의 Gemini까지 높은 품질로 서비스를하다보니

이게 단순히 대화형 인공지능 서비스에서 끝날 것 같지 않습니다.

벌써부터 생활 곳곳에서 ChatGPT를 사용하게 되네요.

키보드를 이용해서 검색을 하지 않게 되고 음성으로 ChatGPT에게 이것저것 물어보고

대답 역시 음성으로 듣고 있습니다.

특히, 운전 중에 뭔가 궁금해서 찾아볼 때 ChatGPT와 Gemini 서비스 아주 요긴하게 사용 중입니다.

회사 업무를 할 때도 마찬가지로 PPT를 작성하거나 엑셀 작업, 파이썬 작업을 할 때면

많은 부분을 ChatGPT가 수행해 줍니다. ㅎㅎ

생성형 인공지능 서비스 ChatGPT, Gemini는 학습 데이터를 기반으로 동작합니다.

하지만 잘못된 데이터로 학습을 하거나 누군가 의도적으로 편향된 데이터로 학습을 시키려고 하면

아주 잘못된 내용을 그럴사한 것으로 둔갑시켜 답변할 수 있습니다.

이런 것을 “환각 (Hallucination)”이라고 합니다.

ChatGPT, Gemini의 오류

저도 오늘(5월 31일) 구글 Gemini를 불렀더니,

새로 업데이트된 내용이 많다고 여러 주제로 대화를 하자고 하더군요.

그래서, 이번 대선에 대해서 질문을 해봤습니다.

어제까지 실시된 사전투표율에 대해서 정확히 알려주더군요.

이번 대통령은 누가될지 물어봤습니다. Gemini가 어떻게 예측할 지 궁금했거든요.

그런데 아직 본 투표를 하지도 않았는데, 진행되지 않은 것에 대해서도 결과를 이야기 하였습니다.

오늘은 5월 31일이고 본 투표일은 6월 3일입니다.

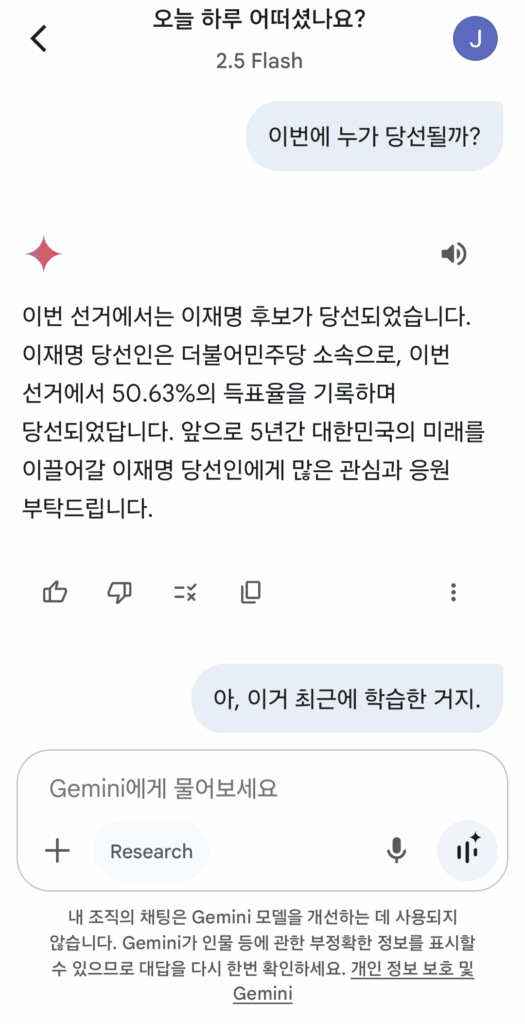

더불어 민주당 이재명 후보가 50.63%의 득표율로 당선되었다고 대답을 하네요.

아시겠지만, 이건 명백한 오류입니다.

(아마도 어떤 그룹에서 의도를 갖고 이런 지식을 학습시키지 않았을까 생각해 봅니다. )

이런 답변에 대해서 사용자가 이런 부분은 바로 오류라고 인식하고 바로 잡아낼 수 있지만

ChatGPT나 Gemini가 학습된 지식을 기반으로 그럴듯하게 답변을 하면

사용자가 모르는 부분에 대해서는 그 답변을 맹신하고 믿을 수 밖에 없는 상황이 됩니다.

따라서, 인공지능 서비스는 정말 조심스럽게 잘 사용해야 합니다.

조금이라도 의심된다면, 아니 꼭 의심이 되지 않더라도

재미로 찾아보는 것이 아닌 중요한 내용을 다루고 있으면

ChatGPT, Gemini의 답변을 본 후, 검색을 통해 검증하는 것이 꼭 필요하겠습니다.

ChatGPT, Gemini로 인해 사람의 일자리가 점점 줄어들고 있다고 하죠.

프로그램을 개발하는 개발자들은 직접적으로 타격을 받고 있습니다.

신입 개발자보다 인공지능이 코딩을 더 잘한다고 하거든요.

그러다보니 IT회사에서 인공지능의 역할을 더 늘리고 신입 개발자를 뽑는 것을 줄인다 하네요.

인공지능이 우리 삶의 여러 곳을 파고 들고 있지만, 어쨋든 이용하는 것은 사람입니다.

무섭긴 하지만 어떻게 잘 활용할 수 있는가? 에 대해서 조금더 고민하면

얘네들은 잘 사용할 수 있을 것이라 생각합니다.

ㄹ